A tecnologia é responsável por abrir infinitas possibilidades ao mundo – desde avanços surpreendentes até possíveis ameaças. Um desses casos que não são positivos diz respeito ao uso de deepfakes, técnicas em que fraudadores usam a Inteligência Artificial (IA) para transformar informações verdadeiras em falsificações convincentes, manipulando imagens, áudios e vídeos para enganar as pessoas.

Uma recente pesquisa da iProov, fornecedora de soluções de identidade biométrica baseadas em ciência, realizada junto a 500 executivos de diversos setores e países, revelou que 70% dos entrevistados acreditam que os ataques das “fake news” criados utilizando ferramentas de IA generativas terão um alto impacto em suas organizações.

Para Fabiano Cruz, CEO da agência Alot, martech especializada na construção e gestão de marcas com estratégias alinhadas à IA, estar à frente dessas ameaças é fundamental. “Os ataques de deepfake não são apenas uma ameaça distante, eles já estão entre nós, impactando organizações globalmente. Para mitigar esses riscos, é crucial adotar uma combinação de ferramentas tecnológicas e práticas de conscientização”, afirma o especialista.

Para ilustrar um exemplo prático, ele relembra o caso de uma empresa multinacional em Hong Kong que em fevereiro deste ano sofreu com um golpe. “Os criminosos utilizaram inteligência artificial para criar vídeos falsos do diretor financeiro da empresa, ordenando a transferência de US$ 25,6 milhões (o equivalente a R$ 127 milhões) em uma videoconferência. Muito sofisticada a fraude, nos chama atenção essa crescente ameaça no ambiente corporativo”, comenta Fabiano.

Pela necessidade de medidas de segurança mais robustas e conscientização sobre tais tecnologias, o CEO elencou três práticas para identificação das deepfakes. Confira:

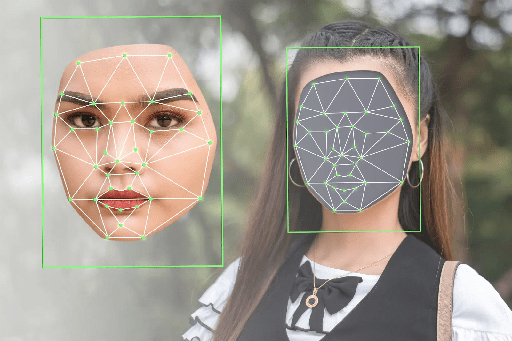

1- Inconsistências visuais: Em vídeos, observe piscadas de olhos irregulares ou movimentos labiais que não sincronizam com a fala. “A IA muitas vezes falha em reproduzir detalhes sutis como o movimento natural dos olhos”, diz Fabiano.

2- Textura da pele: Preste atenção em texturas artificiais ou excessivamente suaves, especialmente em áreas de sombra. “Isso pode ser um sinal claro de manipulação digital”, conta ele.

3- Verificação da fonte: Antes de confiar em um vídeo ou áudio, sempre confirme de onde veio. “Utilizar múltiplos sites de notícias para verificar a autenticidade do conteúdo pode evitar que você seja vítima de uma fraude”, recomenda Fabiano.

De acordo com o especialista, diversas empresas estão investindo em tecnologias para se proteger contra as deepfakes. Por exemplo, a Reality Defender desenvolveu uma ferramenta que detecta deepfakes em tempo real durante chamadas de vídeo. Já a Meta introduziu o AudioSeal, que insere marcas d’água inaudíveis em áudios gerados por IA, ajudando a identificar manipulações de forma eficiente.

Além disso, a Intel criou o FakeCatcher, uma ferramenta inovadora que detecta deepfakes analisando mudanças sutis no fluxo sanguíneo facial, uma abordagem que oferece uma camada extra de segurança para garantir a autenticidade de vídeos.

Educação e conscientização

Fabiano destaca que, além de ferramentas tecnológicas, a alfabetização digital é essencial. “Capacitar colaboradores para identificar manipulações e fraudes é uma parte vital da defesa contra deepfakes. Existem programas de educação digital e workshops sobre alfabetização midiática bem interessantes, por exemplo”, afirma.

“Acreditamos que a tecnologia é uma ferramenta poderosa, mas seu uso responsável é fundamental para proteger nossos negócios e a sociedade”, finaliza Fabiano.